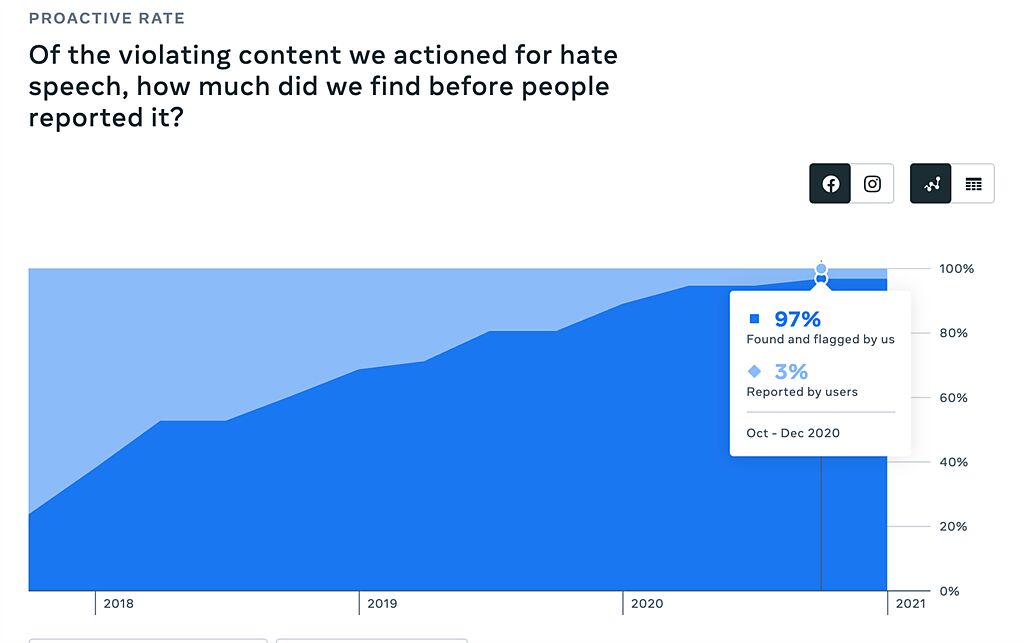

AI助攻 Facebook 2020年Q4主動偵測並下架97.1%仇恨言論貼文

你習慣使用Facebook社群平台嗎?Facebook為了讓使用者能在平台上持續感受到夠安全,能安心發言,也不會受到其他用戶仇恨言論的攻擊,其實在背後投資大量人力物力,要讓這些含有仇恨言論,讓你看起來覺得心裡不舒服的貼文內容,有97.1%(2020年Q4數據)在你甚至都會看見之前,就已經被撤下,讓Facebook成為更令人感到安心的社群平台。

【制定政策】

Facebook 亞太區內容政策經理 Manu Gummi在線上會議中分享,如果用戶不會因為自己的身份被攻擊,他們便能更自在地發言和交流。有鑑於此,Facebook 不允許平台上出現仇恨言論。因為這類言論會造成整個環境充斥著恐嚇與排擠,有時甚至可能會助長實體世界中的暴力行為。因此,Facebook內容政策團隊參考了科技、公共安全和人權等領域的獨立專家所提出的意見,在「社群守則」政策中明訂了平台上可允許及禁止的內容與行為。

當前,Facebook 內容政策團隊全球共有 11 處辦公室,團隊由不同領域的專家組成,例如恐怖主義、仇恨言論和兒童安全。這些專家隸屬於規模更大的 Facebook 團隊,當中共有超過 35,000 人負責處理安全問題,其中也包含超過 15,000 位的內容審查員。

為了跟上不斷變化的網路行為,Facebook內容政策團隊每兩週召開政策論壇(Policy Forum),與會者除了全公司的專家,有時甚至會邀請記者和學者出席會議,來共同討論如何修正「社群守則」及廣告政策。這對仇恨言論等政策相當重要,因為網路用語的意義瞬息萬變,前天才出現的詞彙,隔天便可能成為傷人的用語。因此,「社群守則」可謂是持續滾動式修正的。而為了使Facebook內容政策團隊的業務透明化,每一場政策論壇結束後,皆會發布會議記錄,及更新政策調整內容。

【定義仇恨言論 】

仇恨言論在全球並沒有公認的定義。雖然有些國家立法禁止仇恨言論,但各自的定義卻大不相同。而Facebook 將仇恨言論定義為針對受保護的特徵,直接攻擊他人。該定義是在進行對外大量研究,並諮詢許多獨立專家後所得出的。

一、什麼是直接攻擊?Facebook 對攻擊的定義如下:暴力或抹滅人性(非人化)的言論、有害的刻板印象、貶低性的陳述、表達輕蔑、憎惡或輕視、咒罵、鼓吹排擠或隔離。

二、什麼是受保護的特徵?Facebook 受保護特徵的定義如下:種族、民族/族裔、國籍、身心障礙、宗教信仰、種姓/社會階級、性傾向、性別、性別認同、 重大疾病。若年齡與其他受保護特徵被一同提及,Facebook也會將年齡視為受保護的特徵。對於其他與受保護特徵一併參考的特性(如職業),Facebook 也提供保障。Facebook 也會保護難民、移民、外來移民和尋求政治庇護者,讓他們免於遭受嚴重攻擊,但允許對移民政策的評論和批判。

三、這項政策保障的對象是誰?

Facebook 的仇恨言論政策涵蓋以個人或群體為對象的仇恨言論或圖像,但不包含以實體、意識形態或機構為對象的言論或圖像。

舉例來說,在 Facebook 上「我恨基督徒」這句話屬於仇恨言論且不被允許,因為對象指的是一群人,但「我恨基督教」指的是一種意識形態,因此不會被禁止。

四、攻擊程度:Facebook 將攻擊分為三種嚴重等級並明列在《社群守則》中。

(1)第 1 級:暴力言論、特定抹滅人性(非人化)的比喻、抹滅人性(非人化)的言論、嘲笑仇恨犯罪的概念或受害者

(2)第 2 級:貶低性的陳述,包含生理面、心理面、道德面或泛稱;表達鄙視或厭惡;咒罵

(3)第 3 級:號召排擠或支持隔離,包含明確表達排擠行為、或涉及政治、經濟或社會面上的排擠

也就是說,當你因為上述的「受保護的特徵」,例如種族、性傾向等,受到直接攻擊,且無論攻擊的嚴重等級,Facebook都會針對所分享出來的貼文、照片、圖片等進行處置。

【處理 Facebook 平台上的仇恨言論問題】

透過 Facebook 家族應用程式中提供的工具,Facebook 確保使用者自由管理他們分享的內容和對象、看到的內容,以及誰能與他們聯繫。換句話說,使用者也可採取以下方式來進行自我保護。包含:

一、隱私設定檢查:用戶可以進一步了解分享內容的對象、保障帳號安全的方式、其他人可在 Facebook 上找到用戶的方式、在 Facebook 上的資料設定

二、留言控制選項(Comment controls):用戶可以從選單中選擇適當對象,範圍從可以查看貼文的用戶到僅限標註的用戶及粉絲專頁,控制可以在特定公開貼文留言的對象。

三、分享對象選擇器:每當用戶在 Facebook 發布任何內容時,都可以運用「分享對象選擇器」,選擇誰能看到該內容。用戶可以選擇與所有人分享,也可以選擇只與朋友甚至是自訂對象分享。

四、檢視角度:如果用戶是以電腦使用 Facebook,便可使用「檢視角度」工具,查看其他人看到個人檔案的外觀,如此用戶便能確保隱私和帳戶安全設定符合自身需求。

五、標籤審查和動態時報審查:「標籤審查」可讓用戶批准或隱藏在貼文中加入的標籤;「動態時報審查」則讓用戶決定他們被標註在內的貼文是否能顯示在他們的動態時報。

六、暫停追蹤和取消追蹤:「暫停追蹤」和「取消追蹤」讓用戶進一步控制在 Facebook 平台上與誰聯絡。「暫停追蹤」可讓用戶選擇隱藏用戶、粉絲專頁或社團 30 天,而不需永久取消追蹤對方或從朋友名單中移除。「取消追蹤」則讓用戶保留朋友關係,但對方的內容不會顯示在他們的動態消息中。

【執行政策】

Facebook 會參考社群的檢舉及內部團隊的檢視,並運用相關技術辨識與檢視違反社群守則的內容。隨著技術的進步,Facebook 在解決平台上的仇恨言論取得了重大進展。如 Facebook 的社群守則執行報告所述,在 2019 年 12 月至 2020 年 12 月間,Facebook 採取行動的仇恨言論數量攀升近 400%。

2017 年第 4 季,Facebook 首度納入仇恨言論衡量數據,當時的主動偵測率為 23.6%。換言之, Facebook 移除的仇恨言論中,Facebook 主動發現而非用戶檢舉的比例是23.6%。2020 年第 4 季,Facebook 的主動偵測率攀升至 97.1%,換言之,在短短 3 年內,Facebook 的主動偵測率升幅超過 320%。

以盛行率來看,用戶在 Facebook 平台上每瀏覽 1 萬則內容,約僅有 7 至 8 則內容包含仇恨言論。

Facebook 在處理仇恨言論問題方面的進步,可歸功於下列幾個領域的人工智慧科技發展:

一、XLM-R 或語言理解(lingual understanding):能夠建立機器學習分類器,分析多種語言中的相同概念,在一種語言中的學習成果可以改善在另一種語言中的成效。對於網路上較不常用的語言來說,這項科技格外實用。

二、全文解讀(Whole post understanding)或 WPIE:從整體角度檢視貼文的能力,不論是圖像、影片或文字,並同時找出各種違反政策的問題,而不需執行多種分類器。

此外,Facebook 也運用人工智慧技術,在考量以下幾種因素後,優先處理需要審查的內容:

一、傳播力:與無人分享或觀看的內容相比,疑似違規的瘋傳內容將會更優先獲得處理。

二、嚴重性:與自殺、自殘或兒童剝削等可能造成真實生活傷害相關的內容,優先處理順序將高於如垃圾訊息等傷害程度較低的內容。

三、違規可能性:若有訊號顯示某內容可能與其他違反政策的內容相似,將優先被處理,順序將高於看似未違規的內容。

Facebook 透過上述方式來決定內容的優先處理順序,而非內容在平台的分享時間、或是由用戶檢舉或 Facebook 主動偵測,這讓 Facebook 能優先處理違規最嚴重的內容。基於當前已投注努力所獲得的成果,Facebook也明瞭他們的工作乃是永無止盡,但也對目前的成果感到振奮,且對於未來運用人工智慧科技偵測仇恨言論將更有信心。

(本文由 中時新聞網 提供)